Finanzprognosemodelle mit Künstlicher Intelligenz beschleunigen

Graphcore

Forscher am Oxford-Man Institute of Quantitative Finance (OMI) konnten das Training von hochentwickelten Preisprognosemodellen mithilfe neuester Hardware-Technologie erheblich beschleunigen. Das OMI ist ein interdisziplinäres Forschungsinstitut der Universität Oxford in England und wurde 2007 zusammen mit der Man Group, einem globalen Vermögensverwalter, der Hedgefonds für private und institutionelle Anleger anbietet, gegründet. Die Spitzenforschung im Bereich des maschinellen Lernens und der Datenanalytik steht am OMI somit im ständigen Austausch mit der Investmentbranche.

von Alex Titterton, Field Application Engineer bei Graphcore

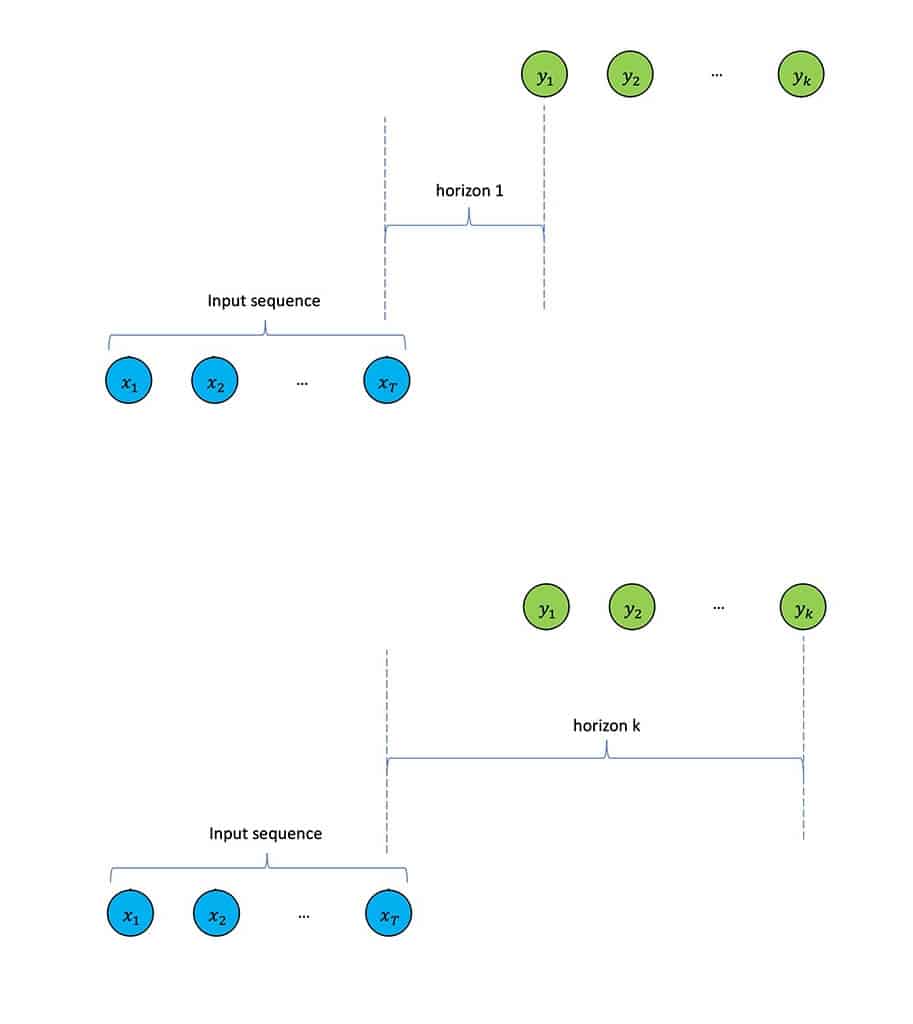

Limit-Order-Bücher (LOBs) – die Aufzeichnung von Geld-/Briefkursen auf den Finanzmärkten – geben einen Echtzeitüberblick über die Handelsstimmung, kodiert in Millionen von Kauf- und Verkaufsaufträgen. Die Analyse der LOBs kann dazu beitragen, Kursbewegungen vorherzusagen, was für die Marktteilnehmer gewinnbringend ist. Dabei geht es jedoch weniger darum, attraktive Aktien zu ermitteln, sondern vielmehr darum, den optimalen Zeitpunkt für die Abwicklung eines Trades zu finden. Künstliche Intelligenz (KI) kann Daten in Orderbüchern mit einem weitaus höheren Grad an Komplexität und folglich Genauigkeit analysieren, als dies mit manuellen Analysen oder herkömmlichen Berechnungen möglich ist.Normalerweise konzentrieren sich die Bemühungen, KI in diesem Bereich anzuwenden, auf Prognosen mit einem einzigen Zeithorizont, die eine Beziehung zwischen einer bestimmten Gruppe von Geld-/Briefkursen und dem resultierenden Marktpreis zu einem vorgegebenen Zeitpunkt (oder Horizont) in der Zukunft herstellen soll.

Bei Finanzprognosen mit mehreren Zeithorizonten werden, wie der Name schon sagt, Preisbewegungen über eine Reihe von Intervallen analysiert, wobei die Ergebnisse für jeden Horizont als Basis für den nächsten dienen. Insgesamt lassen sich daraus deutlich längerfristigere Prognosen ableiten.

Graphcore

Der Nutzen von Prognosemodellen mit mehreren Zeithorizonten wird jedoch – zum Großteil – durch das langsame Training auf CPUs und GPUs erschwert.

Die OMI-Forscher Dr. Zihao Zhang und Dr. Stefan Zohren haben sich die Tatsache zunutze gemacht, dass die Architektur der IPU (Intelligence Processing Unit) des europäischen KI-Chipherstellers Graphcore den rekurrenten neuronalen Schichten, die bei der Multi-Horizont-Prognose verwendet werden, sehr viel ähnlicher ist. Dadurch werden Rechenengpässe vermieden.

Infolgedessen ist ihre Lösung in der Lage, Multi-Horizont Finanzprognosemodelle mit hoher Genauigkeit zu trainieren – und zwar erheblich schneller als mit der bisher eingesetzten GPU-Technologie.

Wir haben Benchmarks mit einer großen Auswahl an interessanten State-of-the-Art Modellen durchgeführt und stellen fest, dass die IPUs um ein Vielfaches schneller als übliche GPUs sind. Ich denke, um eine Zahl zu nennen, dass die Lösung mindestens zehnmal schneller ist.“

Dr. Zihao Zhang

Alex Titterton ist Field Application Engineer beim europäischen KI-Chiphersteller Graphcore (Webseite). Er hat einen Doktortitel in Teilchenphysik, der ihm gemeinsam von der University of Bristol und der University of Southampton verliehen wurde. Im Rahmen seines Studiums zog er 2017 nach Frankreich, um am Large Hadron Collider Teilchenbeschleuniger des Europäischen Kernforschungszentrums CERN zu arbeiten.

Alex Titterton ist Field Application Engineer beim europäischen KI-Chiphersteller Graphcore (Webseite). Er hat einen Doktortitel in Teilchenphysik, der ihm gemeinsam von der University of Bristol und der University of Southampton verliehen wurde. Im Rahmen seines Studiums zog er 2017 nach Frankreich, um am Large Hadron Collider Teilchenbeschleuniger des Europäischen Kernforschungszentrums CERN zu arbeiten.Die kommerzielle Anwendbarkeit der neuesten Forschungsergebnisse des OMI wird von Man AHL, dem diversifizierten quantitativen Investmentmanager der Man Group, in Betracht gezogen.

Dr. Anthony Ledford, Leitender Wissenschaftler bei Man AHL, sagt dazu: „Wenn wir feststellen, dass die IPU diese Art von Berechnungen deutlich beschleunigen würde, sehe ich eine erhebliche Nachfrage.“

Herausforderungen rekurrenter Modelle

Prognosen mit einem Zeithorizont werden normalerweise als Standardproblem des überwachten Lernens behandelt. Ziel dabei ist es, eine Beziehung zwischen Kauf-/Verkaufspreisen in einem Orderbuch und dem resultierenden Marktpreis zu einem bestimmten Zeitpunkt herzustellen. Angesichts der Vielzahl an Faktoren, die auf die Marktpreise einwirken, und des relativ niedrigen Anteils an nützlichen Signalen im Verhältnis zum Grundrauschen ist es jedoch schwierig, aus einem einzigen Zeithorizont einen längerfristigen Prognosepfad abzuleiten.

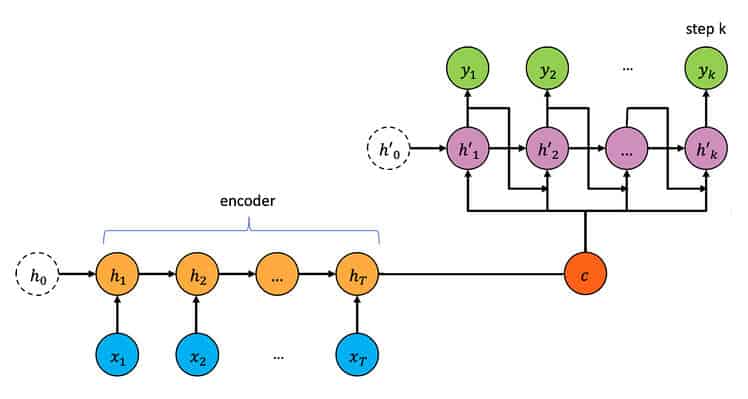

Eine Technik zum Erstellen von Prognosen mit mehreren Zeithorizonten lehnt an einen Ansatz an, der in der maschinellen Verarbeitung natürlicher Sprache (Natural Language Processing, NLP) gängig ist. Dabei werden Seq2Seq- und Attention-Modelle genutzt, die auf komplexen rekurrenten neuronalen Schichten basieren und einen Encoder und einen Decoder beinhalten. Der Seq2Seq-Encoder fasst vergangene Zeitreiheninformationen zusammen, während der Decoder versteckte Zustände mit zukünftigen bekannten Informationen kombiniert, um Prognosen zu generieren. Das Attention-Modell hilft bei der Umgehung bestimmter Einschränkungen von Seq2Seq-Modellen, die sie daran hindern, lange Sequenzen zu verarbeiten.

Graphcore

Die wiederkehrende Struktur dieser Modelle ist für die parallele Verarbeitung auf Prozessorarchitekturen wie der der GPU jedoch nicht nützlich. Besonders problematisch ist dies angesichts des hohen Tempos, in dem moderne elektronische Börsen Orderbuchdaten generieren.

Neue Herangehensweise mit Attention-Modellen

Für dieses Berechnungsproblem wurden mehrere Lösungen vorgeschlagen, u. a. der Einsatz von Transformatoren mit vollständig verbundenen Schichten.

Das OMI-Team war jedoch der Ansicht, dass die rekurrente Struktur der Seq2Seq/Attention-Kombination gut mit der Art der Zeitreihen bei Multi-Horizont-Prognosen übereinstimmt und die Zusammenfassung von Informationen aus der Vergangenheit und die Weitergabe an einen nachfolgenden Zeitpunkt ermöglicht.

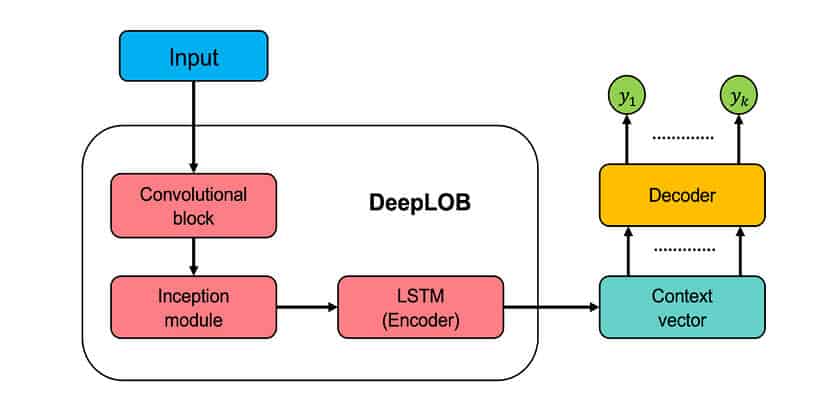

Um diesen Ansatz in die Praxis umsetzen zu können, brauchten sie eine leistungsfähigere Rechenplattform. Daher testete das Team seinen Ansatz mit der IPU von Graphcore. Die Orderbuchdaten wurden verwendet, um eine Reihe von Modellen auf der IPU zu trainieren, darunter auch DeepLOB, das zuvor vom gleichen OMI-Team entwickelt wurde (Zhang et al., 2019). In Bezug auf Prognosen mit mehreren Zeithorizonten testeten die Forscher zwei DeepLOB-Varianten: DeepLOB-Seq2Seq und DeepLOB-Attention, die Seq2Seq- bzw. Attention-Modelle als Decoder verwenden.

Graphcore

Leistungssteigerung beim Training

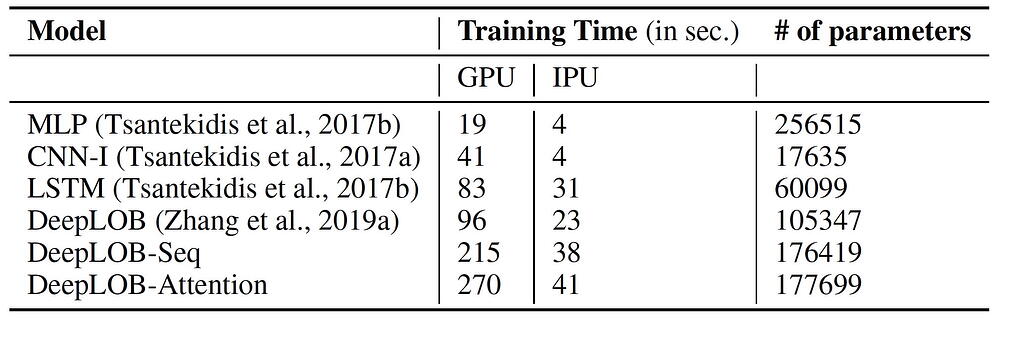

Bei verschiedenen Modellen, darunter DeepLOB-Seq2Seq und DeepLOB-Attention, übertraf das IPU-System von Graphcore seinen GPU-Konkurrenten im Hinblick auf die Trainingszeit.

Graphcore

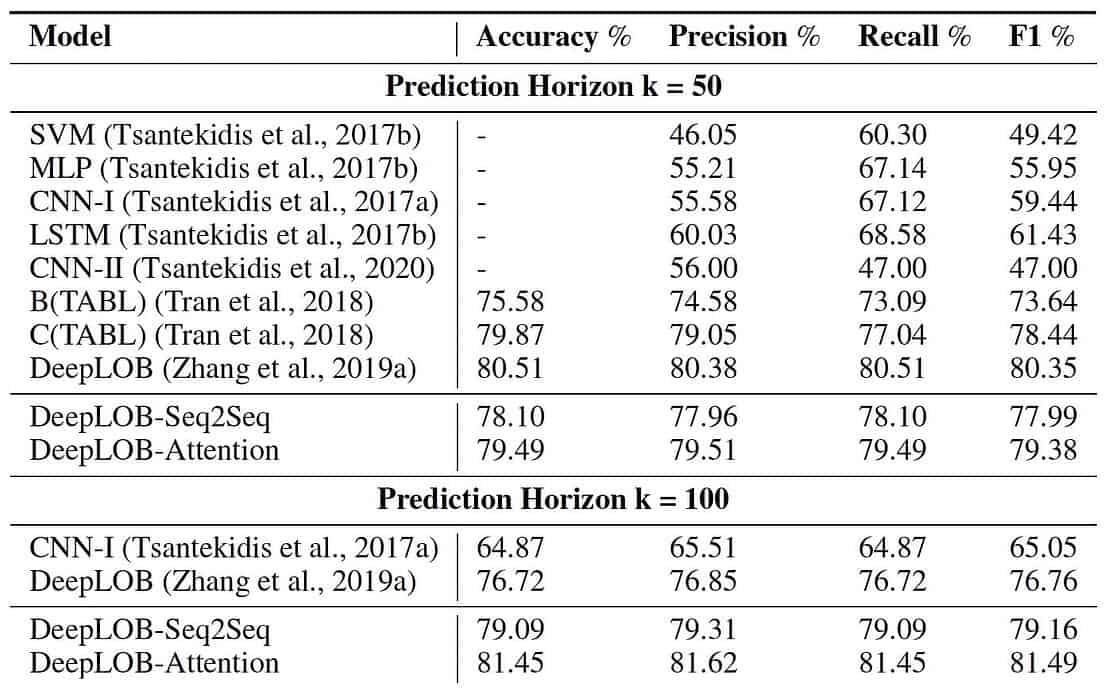

Darüber hinaus überzeugten die neuen Modelle mit einer herausragenden Prognosegenauigkeit, sowohl bei kürzeren Zeithorizonten wie K=10 als auch – und das ist entscheidend – bei den längsten Zeithorizonten wie K=50 und K=100. Hier steht K für die „Tickerzeit“, die Ereigniszeit, in der Nachrichten an der Börse eingehen. Dies ist eine natürliche Zeit, die für liquidere Wertpapiere schneller und für weniger liquide Wertpapiere langsamer tickt. Die Modelle mit mehreren Zeithorizonten, DeepLOB-Seq2Seq und DeepLOB-Attention, erzielten die höchste Genauigkeit und Präzision, wenn sie für Prognosen mit längeren Zeithorizonten verwendet wurden.

Graphcore

Eine vollständige Tabelle der Modelltypen und der Leistung im Hinblick auf mehrere Zeithorizonte ist in der ausführlichen OMI-Studie zu finden.

Die nächsten Schritte

Dr. Zhang und Dr. Zohren sind überzeugt, dass die in ihrer Forschung demonstrierten Funktionsweisen bei Verwendung der Graphcore-IPU eine Vielzahl von Anwendungen eröffnen könnten, wie zum Beispiel die Nutzung von Online-Lernen oder Reinforcement-Lernen im Zusammenhang mit Market-Making.

Es ist auch möglich, dass sie die Anwendung der Encoder-Decoder-Struktur auf ein Reinforcement-Learning-Framework System in Betracht ziehen, wie in einem ihrer früheren Forschungspapiere.

Reinforcement-Learning-Algorithmen bieten einen ausgezeichneten Rahmen, um derartige Prognosen mit mehreren Zeithorizonten in einer optimalen Ausführungs- oder Market-Making-Umgebung anzuwenden. Angesichts der Rechenkomplexität dieser Algorithmen könnte die Beschleunigung mit IPUs in dieser Konfiguration sogar noch größer sein.“

Dr. Zihao Zohren Alex Titterton, Graphcore

Sie finden diesen Artikel im Internet auf der Website:

https://itfm.link/134125

Schreiben Sie einen Kommentar